Употребата на вештачката интелигенција (AI) постојано расте низ целиот свет, а технологијата се применува во бројни сектори како поддршка на човечкиот труд. Иако нејзините предности не се спорни, расте и загриженоста за можните негативни последици, како што е укинувањето на работни места. Во светло на тие дилеми, популарниот четбот „ChatGPT“ беше запрашан што го смета за најстрашен аспект на технологијата чиј дел е и самиот.

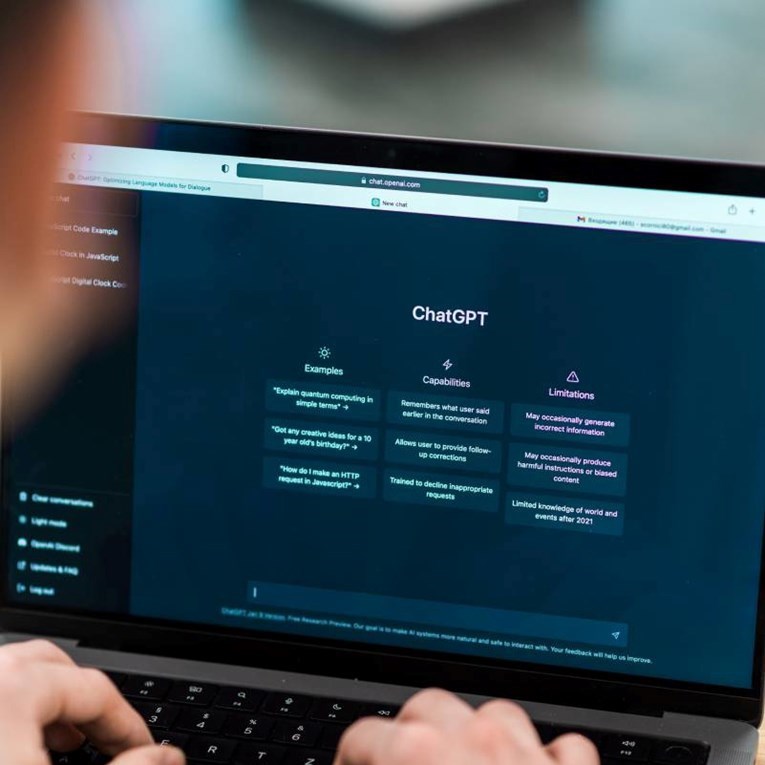

„Најстрашната работа кај вештачката интелигенција не е едно драматично сценарио, туку мноштво тивки, суптилни ризици што ги воведува истовремено“, гласеше директниот одговор на популарниот четбот. Потоа наведе шест клучни причини за загриженост.

Сложеност што ни креаторите не ја разбираат

„AI системите можат да станат толку сложени што дури ни нивните создавачи не ја разбираат целосно логиката зад нивните одлуки“, објасни четботот. „Тоа е особено загрижувачко во високоризични области како здравството, финансиите или одбраната, каде што грешките стануваат очигледни дури кога веќе е предоцна.“

Создавање убедливи лажни информации

„ChatGPT“ понатаму предупреди дека вештачката интелигенција може да генерира многу убедлив текст, слики и звук, што би можело да доведе до масовно ширење дезинформации.

Недостаток на морал и можност за злоупотреба

Четботот исто така истакна дека вештачката интелигенција, за разлика од луѓето, нема морален компас и едноставно ги следи инструкциите што ѝ се зададени. Тоа значи дека може да биде искористена за спроведување „пософистицирани измами“, „автоматизирање кибернапади“ и „генерирање штетна содржина во голем обем“, наведе „ChatGPT“.

Губење на работни места и продлабочување на нееднаквоста

„Вештачката интелигенција може да укине или трансформира работни места побрзо отколку што општествата можат да се прилагодат и да ги преквалификуваат луѓето“, стои во одговорот. „Застрашувачкиот дел не е само губењето на работни места, туку и продлабочувањето на нееднаквоста ако придобивките од АИ се концентрираат во рацете на мал број луѓе.“

Пресликување на човечките предрасуди

Една од опасностите лежи и во фактот што вештачката интелигенција учи од податоци создадени од луѓе, поради што неизбежно ги пресликува и „човечките предрасуди“. „Тоа може да доведе до неправедни исходи при вработување, одобрување кредити, полициско постапување и на други места, често на начини кои тешко се откриваат“, додаде четботот.

Опасност од преголемо потпирање

Конечно, „ChatGPT“ предвидува дека луѓето во иднина би можеле премногу да се потпираат на вештачката интелигенција и да ѝ веруваат дури и кога дава неточни информации. „Ако престанеме критички да ја преиспитуваме, нејзините грешки може незабележливо да се вовлечат во нашите одлуки, системи и уверувања“, заклучи.